Veel bedrijven denken nog altijd dat ze “geen AI gebruiken”. Maar de realiteit is anders. In de meeste organisaties wordt AI vandaag al gebruikt, alleen niet altijd officieel. Medewerkers zetten generatieve AI in om mails te schrijven, rapporten samen te vatten, marketingteksten te maken of data te analyseren. Vaak gebeurt dat via persoonlijke accounts en zonder dat IT of management hiervan op de hoogte is. Dit fenomeen noemen we shadow AI: het gebruik van AI-tools buiten het formele beleid of zonder expliciete goedkeuring van de organisatie.

De vraag is niet of AI in je organisatie aanwezig is. De vraag is of je het weet.

AI is al ingeburgerd – ook in jouw organisatie

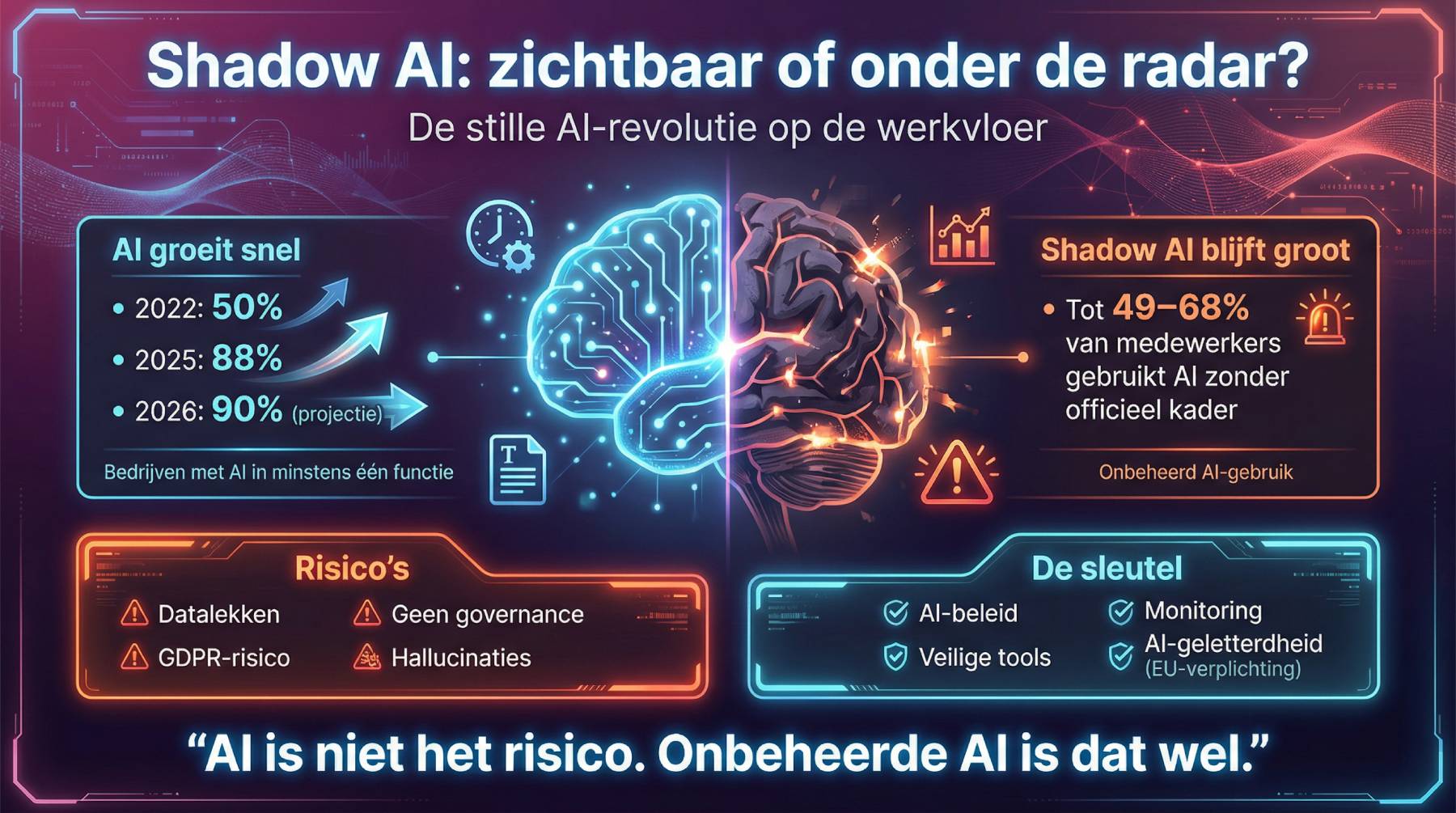

De opmars van AI is indrukwekkend. Wereldwijd gebruikt vandaag bijna 8 op de 10 organisaties AI in minstens één bedrijfsfunctie. Recente internationale studies tonen zelfs dat bijna 90% van de bedrijven AI actief inzet. In België gebruikt meer dan één op drie ondernemingen AI, en bij grote bedrijven loopt dat cijfer op tot meer dan 70%. Tegelijkertijd blijkt dat slechts een minderheid AI volledig strategisch heeft geïntegreerd in beleid, processen en governance. AI groeit dus sneller dan het kader eromheen.

Op individueel niveau gaat het nog sneller. Driekwart van de kenniswerkers gebruikt vandaag AI-tools op het werk. Een opvallend deel doet dat via een persoonlijk account in plaats van via een bedrijfslicentie. In verschillende onderzoeken geeft bijna de helft van de werknemers toe AI-tools te gebruiken zonder expliciete toestemming van IT of management. Wat voor veel directies nog een toekomstverhaal lijkt, is in werkelijkheid al dagelijkse praktijk.

Waarom medewerkers AI onder de radar gebruiken

Shadow AI ontstaat zelden uit slechte intenties. Het ontstaat uit ambitie, tijdsdruk en efficiëntiebehoefte. AI helpt mensen sneller werken, repetitieve taken automatiseren en creatiever denken. Meer dan 80% van de AI-gebruikers geeft aan productiever te zijn dankzij AI. Velen ervaren dat ze zich beter kunnen focussen op hun kerntaken en minder tijd verliezen aan routinewerk. Een aanzienlijk deel zegt zelfs bereid te zijn risico’s te nemen als AI hen helpt deadlines te halen of hun werkdruk te verlagen.

In de praktijk gebruiken medewerkers shadow AI voor zeer concrete taken, vaak zonder zich volledig bewust te zijn van de mogelijke gevolgen:

- Het herschrijven of verbeteren van e-mails en interne communicatie

- Het samenvatten van vergaderverslagen of lange documenten

- Het opstellen van offertes, contracten of commerciële voorstellen

- Het analyseren van Excel-bestanden of financiële rapporten

- Het genereren van marketingteksten, social media posts en blogartikelen

- Het vertalen van documenten of klantcommunicatie

- Het schrijven of optimaliseren van code

- Het voorbereiden van presentaties en strategische nota’s

- Het opstellen van HR-documenten of functieomschrijvingen

Daarnaast spelen praktische factoren mee. AI-tools zijn vaak gratis en onmiddellijk beschikbaar, terwijl interne oplossingen soms trager worden uitgerold. Wanneer duidelijke richtlijnen ontbreken, zoeken medewerkers hun eigen oplossingen. Zonder beleid ontstaat vanzelf een informele praktijk.

Waar geen kader is, ontstaat schaduw.

De risico’s van shadow AI

Hoewel shadow AI voortkomt uit positieve intenties, zijn de risico’s reëel. Een eerste en belangrijkste risico is datalekken en privacyproblemen. Werknemers voeren soms – vaak zonder het volledige besef van de gevolgen – gevoelige informatie in publieke AI-systemen in: klantgegevens, contracten, financiële cijfers of interne strategieën. Onderzoeken tonen aan dat organisaties gemiddeld honderden AI-gerelateerde data-incidenten per maand registreren. Meer dan de helft van de werknemers geeft toe ooit gevoelige informatie in een AI-tool te hebben ingevoerd. Bij AI-gerelateerde datalekken blijkt klantinformatie het vaakst getroffen, wat onder GDPR zware financiële en reputatieschade kan veroorzaken.

Daarnaast is er het gebrek aan controle. Wanneer AI via persoonlijke accounts wordt gebruikt, is er geen logging, geen toegangscontrole, geen monitoring en geen audittrail. IT heeft geen zicht op welke data worden ingevoerd of hoe output wordt gebruikt. Wat je niet ziet, kan je niet beveiligen. Veel gratis AI-platformen gebruiken ingevoerde data bovendien voor verdere modeltraining. Zonder duidelijke enterprise-afspraken kan bedrijfsinformatie zo buiten de controle van de organisatie terechtkomen.

Ook inhoudelijke risico’s spelen mee. Publieke AI-modellen maken nog steeds fouten. Hallucinaties – foutieve maar overtuigend geformuleerde antwoorden – komen nog regelmatig voor. Wanneer output niet kritisch wordt gecontroleerd, kan dat leiden tot verkeerde analyses, foutieve juridische interpretaties of reputatieschade.

“AI versnelt alles – ook fouten en risico’s – wanneer er geen kader is.”

AI verbieden is geen oplossing

Het zou logisch lijken om AI simpelweg te verbieden. In de praktijk werkt dat averechts. Onderzoek toont aan dat een strikt verbod medewerkers niet tegenhoudt, maar hen net aanzet om AI via privétoestellen of alternatieve accounts te gebruiken. Het gebruik verdwijnt dan niet, maar wordt nog minder zichtbaar.

Het probleem is niet de technologie zelf. AI verhoogt productiviteit, stimuleert creativiteit en versnelt processen. AI-gebruikers besparen tijd, kunnen zich beter focussen en genereren sneller nieuwe ideeën. Het echte probleem is het ontbreken van structuur, beleid en opleiding.

“AI is geen risico. Onbeheerde AI is dat wel.”

De sleutel: structuur, governance en AI-geletterdheid

De oplossing ligt in het omarmen van AI, maar binnen duidelijke grenzen. Organisaties die AI slim integreren met heldere richtlijnen, veilige tools en opleiding zien minder risico’s en meer rendement. Door AI bespreekbaar te maken, goedgekeurde tools aan te bieden en basisgovernance in te voeren, wordt shadow AI omgezet in strategische AI.

Een cruciale hefboom daarbij is AI-geletterdheid. Met de Europese AI Act wordt AI-geletterdheid geen vrijblijvende aanbeveling meer, maar een expliciete verantwoordelijkheid voor organisaties. Bedrijven moeten kunnen aantonen dat medewerkers die met AI werken de risico’s begrijpen, weten welke data ze mogen gebruiken, output kritisch kunnen beoordelen en ethische principes respecteren. AI-geletterdheid gaat dus veel verder dan “leren prompten”. Het gaat over inzicht in werking, beperkingen, dataveiligheid, compliance en kritisch denken.

Zonder opleiding blijft AI een risico. Met opleiding wordt AI een hefboom voor groei en innovatie.

Van shadow AI naar strategisch voordeel

Shadow AI is geen vijand, maar een signaal. Het toont aan dat medewerkers vooruit willen, efficiënter willen werken en openstaan voor innovatie. De keuze voor organisaties is duidelijk: ofwel laat je AI onder de radar groeien, ofwel neem je de regie en maak je er een strategisch voordeel van.

Wij helpen organisaties om die stap te zetten. Met gerichte AI-trainingen, workshops rond veilig gebruik en begeleiding bij het uitwerken van beleid zorgen we ervoor dat AI-gebruik veilig, compliant en toekomstgericht wordt geïntegreerd in de werking van het bedrijf. Zo verminder je risico’s, verhoog je productiviteit en voldoe je aan de Europese verplichtingen rond AI-geletterdheid.